Content-Note: Dieser Artikel behandelt Tod und Terror. Für einige Leser kann dies verstörend wirken.

In Sydney am Bondi Beach ist am Wochenende ein antisemitischer IS-Anschlag auf eine Chanukka-Feier verübt worden. Menschen wurden erschossen und verletzt, Angehörige trauern, viele stehen unter Schock. In solchen Stunden ist es normal, nach Erklärungen zu suchen, nach Namen, nach Bildern, nach einem „Was ist da passiert?“. Genau diese Ungeduld ist aber auch der Moment, in dem Desinformation am leichtesten zündet.

Im Mittelpunkt der Berichterstattung steht dabei ein Mann, der in einem Video zu sehen ist, wie er einen der Angreifer von hinten überwältigt und entwaffnet: Ahmed al-Ahmed. Sein Eingreifen hat vermutlich zahlreichen Menschen das Leben gerettet. Seriöse Medien haben seine Identität sehr schnell verifiziert. The Guardian berichtet, ein Angehöriger habe ihn als „Australian citizen of Syrian origin“ beschrieben, aus Idlib, und zitiert zudem Aussagen der Familie zu den Gründen seines Eingreifens. Auch ABC News lässt seine Eltern zu Wort kommen; dort wird unter anderem berichtet, dass die Eltern erst vor einigen Monaten aus Syrien nach Sydney gekommen seien und dass Ahmed Brüder hat, von denen einer in Deutschland leben soll.

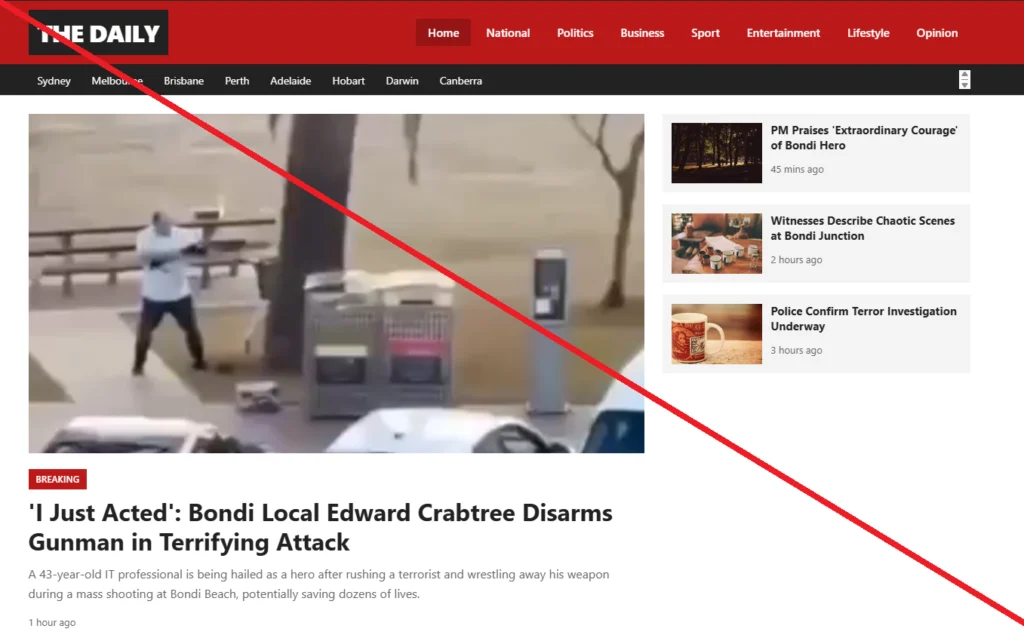

Und trotzdem kursierte kurz nach dem feigen Anschlag eine „News“-Seite, die etwas ganz anderes behauptete: Der Held vom Bondi Beach sei gar nicht Ahmed al-Ahmed, sondern ein angeblicher australischer IT-Profi namens Edward Crabtree. Das ist kein harmloser Irrtum. Das ist der Kern einer gezielten Erzählung: Wenn ein Obstladenbesitzer syrischer Herkunft als Held sichtbar wird, muss diese Tatsache für manche offenbar weg. Es widerlegt nämlich ein rechtsextremes Narrativ: Die extreme Rechte möchte, dass wir Migranten mit Islamismus und Antisemitismus verknüpfen. Da passt es nicht ins Bild, wenn sie genauso Opfer sind oder – wie im Falle von Ahmed al-Ahmed – gar die Helden, die mutig die antisemitischen Terroristen überwältigen.

Passt nicht ins rechtsextreme Weltbild

Fake News verbreiten sich besonders dann gut, wenn eine Information einfach nicht so recht ins schön zurechtgelegte Weltbild passt. Das trifft besonders auf Rechtsextreme zu, aber nicht nur, auf die: Jeder von uns kann auf Nachrichten reinfallen, wenn sie genau das bestätigen, was wir ohnehin schon glauben.

Das macht es auch möglich, zielgerichtet Nachrichten zu erstellen, die bei einer bestimmten Gruppe viral gehen sollen. Das scheint hier passiert zu sein.

So entstand der Fake

Die Seite mit dem Fake thedailyaus.world klingt so ähnlich wie eine echte News-Seite: https://thedailyaus.com.au.

Hier die echte News-Seite:

Hier der Fake:

Wie kann man also erkennen, dass die Seite gar nicht echt ist?

Schaut man sich die Informationen der Domain an, stellt man fest, dass thedailyaus.world kürzlich registriert worden ist. Das könnt ihr hier nachprüfen. Das Hosting der Seite kann man auch nachschauen, zum Beispiel hier.

Man sieht hier: Die Seite wird bei „vercel“ gehostet, das ist erst mal nicht verdächtig. Vercel hat aber auch einen Service zum KI-generieren von Websites namens v0.app. Wir haben das mal getestet und einfach der v0-KI gesagt, sie soll einen Spiegel-Klon nur von einem Screenshot erstellen. Die KI erfüllt die Anfrage bereitwillig. Das erste Ergebnis ist bereits erschreckend akkurat:

Die ganze Seite ist also vermutlich KI-generiert, der Text zeigt bei KI-Detektoren ebenfalls deutliche Anzeichen von KI. Wenn man sich auch alle anderen Artikel ansieht, stellt man schnell fest: Das ist immer der gleiche Artikel, nur mit anderer Überschrift. Die Seite ist sonst leer.

Das gibt es jetzt öfter

ChatGPT wurde auch vom Kreml bei der Doppelgänger-Kampagne verwendet, bei der in Deutschland Medien nachgeahmt wurden. Unter anderem auch der SPIEGEL, weshalb wir das Beispiel genommen haben. Das FBI nahm mehrere Websites vom Netz, die Teil dieser Propaganda-Kampagne waren.

Viele der Websites instrumentalisierten auch Hass gegen Friedrich Merz, um in linken Kreisen geteilt zu werden und die demokratischen Parteien zu spalten:

KI macht Fakes schlimmer

Okay, KI kann also Fake News in großem Stil verbreiten, aber kann sie auch helfen, indem man Chatbots fragt, ob etwas Fake ist? Tja, das hat leider bei der Bondi Beach Attacke vor allem dazu geführt, dass MEHR Fakes in Umlauf kamen.

Musks Chatbot Grok hat etliche Fakes auf Twitter aufgesaugt und verbreitet, zum Beispiel ebenfalls die Lüge über jenen „Edward Crabtree“.

Andere Nutzer nutzen ChatGPT, um ihre Vorurteile zu bestätigen. Beispielsweise fragten User den Chatbot, ob ein Selfie eines Überlebenden bei Bondi Beach gefilmt wurde. Der User wollte beweisen, dass es sich bei den Verletzten und Toten um Fake-Bilder handelt. Der Chatbot, der davon keine Ahnung hat, antwortete mit „Nein“. Es gibt dabei sogar ein Video-Interview mit dem Überlebenden:

Trotzdem vertraute der Nutzer eher der fehlerhaften KI.

Folgt seriösen Medien – misstraut KI

Seriöse Medienseiten stellen bei solchen Ereignissen meistens Live-Feeds zur Verfügung. Wenn die etwas nicht berichten, dann hat es vermutlich einen Grund. Betrüger nutzen unsere Ungeduld und das Fehlen von Informationen, um Fake News zu pushen. Wir wissen es ohnehin erst sicher, wenn seriöse Medien es berichten. In den endlosen Feeds von Social Media, muss man heutzutage einfach so vorsichtig sein, dass es meistens einfach nicht empfehlenswert ist, seine Informationen von dort zu beziehen, gerade wenn man anfällig ist.

KI ist mittlerweile sehr gut im Verfassen von Fakes, aber im Aufdecken hinkt sie noch weit hinterher. Wer sich darauf verlässt, der fällt erst recht auf Fake News herein.

Leider ist manchen Leuten halt auch alles egal, sie glauben ohnehin, was sie wollen. Wenn du schon nicht zu denen gehörst, sondern auch bereit bist, dein eigenes Weltbild zu hinterfragen, bist du bereits auf dem richtigen Weg.

Spenden für den Helden von Bondi Beach

Ahmed al-Ahmed hat seine Heldentat überlebt, musste aber ins Krankenhaus: Er wurde bei dem Angriff angeschossen und musste operiert werden. Seitdem erhält er viel hohen Besuch und Lob. Gleichzeitig setzte eine Welle ganz praktischer Solidarität ein, die zeigt, dass Anerkennung nicht nur aus Symbolen bestehen muss: Eine Spendenkampagne brachte laut Agenturberichten schon innerhalb von zwölf Stunden mehrere hunderttausend Dollar zusammen, und inzwischen liegt die Summe sogar bei über zwei Millionen Dollar; Menschen legten zudem Blumen an Orten nieder, die mit seinem Alltag verbunden sind, und aus dem Krankenhausbett bedankte er sich bei Unterstützern.

Das heroische Eingreifen von Ahmed al-Ahmed bei Bondi Beach war im Übrigen kein Einzelfall. Immer wieder verhindern Mitbürger durch Zivilcourage Schlimmeres. Muhammad Al Muhammad stoppte dieses Jahr am Hamburger Hauptbahnhof eine Messerattacke einer Deutschen. Alaaeddin al-Halabi stoppte in Österreich ebenfalls dieses Jahr einen Angreifer mit seinem Auto, danach wurde er von IS-Fanatikern bedroht und stand unter Polizeischutz. Am Bondi Beach versuchten auch Boris und Sofia Gurman, einen der Angreifer zu stoppen, wurden aber dabei getötet.

Es sind die wichtigeren Geschichten als diejenigen, die von den mörderischen Islamisten und Rechtsextremisten geteilt werden, die uns spalten wollen. Dennoch ist es auch wichtig, im Blick zu behalten, dass auch hierzulande Antisemitismus zunimmt. Besonders nach dem Angriff der Hamas vom 7. Oktober auf unschuldige Zivilisten gab es immer mehr Demos und Äußerungen, in denen Gewalt und die Hamas befürwortet wurden. Es ist auch dieser Hass, der zu derartigen antisemitischen Angriffen führen kann. Antisemitismus darf keinen Platz haben in unserer Demokratie. Wir stehen zusammen gegen Islamismus, mit derselben Entschlossenheit, die wir gegen Faschisten haben. Lasst euch nie gegen eure Mitmenschen aufhetzen.

Artikelbild: Australian Prime Minister Office/Australian Prime Minister Office/AP/dpa. Teile des Artikels wurden mit maschineller Hilfe erstellt. Wie Volksverpetzer KI verwendet.